Wenn ein KI-Charakter über 100 Bilder hinweg dieselbe Person bleiben soll — gleicher Blick, gleiche Mimik, gleiche Haut, gleiche kleine Asymmetrie über dem linken Auge — dann gibt es 2026 ein Modell, das fast alle anderen schlägt: Nano Banana 2 von Google.

Du brauchst keine Lora-Trainings, keine ComfyUI-Pipelines, keinen RTX-4090-PC. Du brauchst ein Reference-Bild, einen sauberen Prompt und das richtige Verständnis, wie Nano Banana 2 mit Identitäten umgeht.

In dieser Anleitung zeige ich dir Schritt für Schritt, wie du deinen ersten konsistenten KI-Charakter baust, welche Plattformen sich für welchen Use-Case lohnen, und gebe dir 10 fertige Prompt-Templates für KI Influencer, die du direkt kopieren kannst. Wir bauen am Ende eine eigene Reference-Library, die deine Identität dauerhaft stabil hält — die Killer-Funktion, die Nano Banana 2 von Midjourney, Flux und Co. abhebt.

Wenn du noch ganz am Anfang stehst und überlegst, wie du überhaupt einen KI-Influencer erstellen sollst, lies diesen Guide zuerst und komm dann hierher zurück.

Was Nano Banana 2 ist

Nano Banana 2 ist Googles Gemini 3 Pro Image — der Bildgenerierungsmodus des Gemini-3-Pro-Modells, intern bei Google als „Nano Banana 2″ geführt und Ende 2025 veröffentlicht. Anders als das ursprüngliche Nano Banana (Gemini 2.5 Flash Image) läuft NB2 auf einem deutlich größeren Reasoning-Modell und ist nativ in einen LLM eingebettet. Das heißt: Das Modell versteht deinen Prompt sprachlich statt nur Tokens zu matchen, und es kann bis zu 14 Reference-Images gleichzeitig verarbeiten.

In der Praxis bedeutet das drei Dinge: deutlich bessere Identitätskonsistenz, korrekt gerendertes Text-im-Bild auch auf Deutsch, und ein präziseres Verständnis räumlicher Anweisungen („Charakter steht links neben dem Café-Tisch, schaut über die rechte Schulter“). Genau diese Eigenschaften machen NB2 zur ersten Wahl für KI-Influencer-Workflows.

Wo steht Nano Banana 2 im Vergleich? Wie sich NB2 gegen Flux, Seedream, Ideogram und die anderen sechs großen Modelle schlägt, haben wir im Pillar-Artikel detailliert auseinandergenommen: Vergleich der 7 besten KI-Bildmodelle für AI Influencer →

Voraussetzungen & Zugang: Wo du Nano Banana 2 nutzen kannst

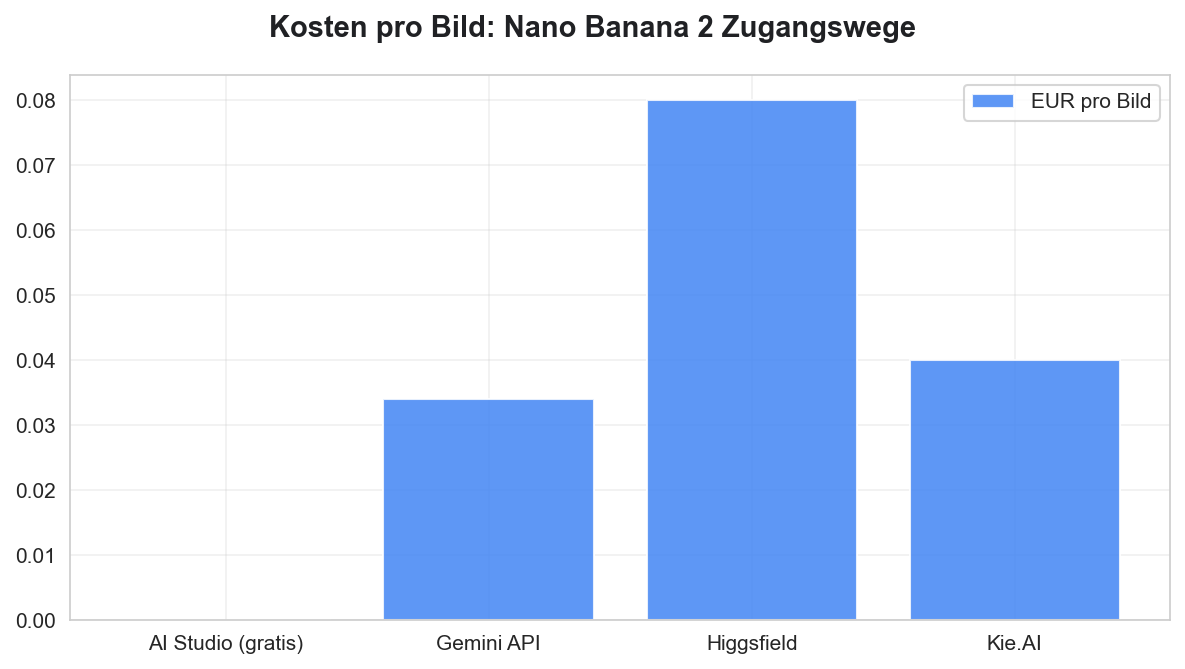

Es gibt 2026 vier sinnvolle Wege, Nano Banana 2 zu verwenden — abhängig davon, ob du gerade testest, einen einzelnen Influencer pflegst oder eine ganze Charakter-Pipeline industriell skalierst.

1. Google AI Studio (kostenlos)

Der einfachste Einstieg. Du loggst dich mit deinem Google-Account auf aistudio.google.com ein, wählst „Gemini 3 Pro Image“ und kannst loslegen. Reference-Image-Upload funktioniert per Drag & Drop. Limit: ~50 Bilder pro Tag, kein API-Zugriff, kein Batch-Modus. Ideal zum Testen, Prompt-Engineering und für Hobby-Workflows.

2. Gemini API (€0,03–0,04 pro Bild)

Für alles, was skaliert. Du holst dir einen API-Key in der Google Cloud Console, aktivierst die Gemini-API und rufst das Modell gemini-3-pro-image direkt auf. Du zahlst pay-as-you-go pro Bild, kein Abo. Perfekt, wenn du eigene Skripte oder Tools baust und 200+ Bilder pro Tag generierst.

3. Higgsfield (Managed UI)

Higgsfield bündelt mehrere Top-Modelle (inkl. NB2) in einer Web-Oberfläche, die speziell für Charakter-Workflows gebaut ist: Reference-Library-Verwaltung, Prompt-Vorlagen, automatische Variation-Sets. Kostet ~€0,08 pro Bild im Pro-Tarif, aber du sparst extrem viel Zeit beim Asset-Management. Mehr Tools dieser Art findest du in unserem Überblick der besten KI-Bildgeneratoren für AI Influencer.

4. Kie.AI (alternative API, pay-as-you-go)

Die simpelste API-Alternative ohne Google-Cloud-Aufwand. Ein Endpoint, ein Key, ~€0,04 pro Bild. Unterstützt nativ den 14-Reference-Image-Workflow. Beliebt für Indie-Entwickler und Bridge-Skripte.

Welcher Weg für wen?

- Du testest gerade? → AI Studio

- Du baust eine Pipeline? → Gemini API oder Kie.AI

- Du willst kein Setup, sondern ein Tool? → Higgsfield

- Du brauchst maximale Kontrolle und planst >500 Bilder/Monat? → Gemini API direkt

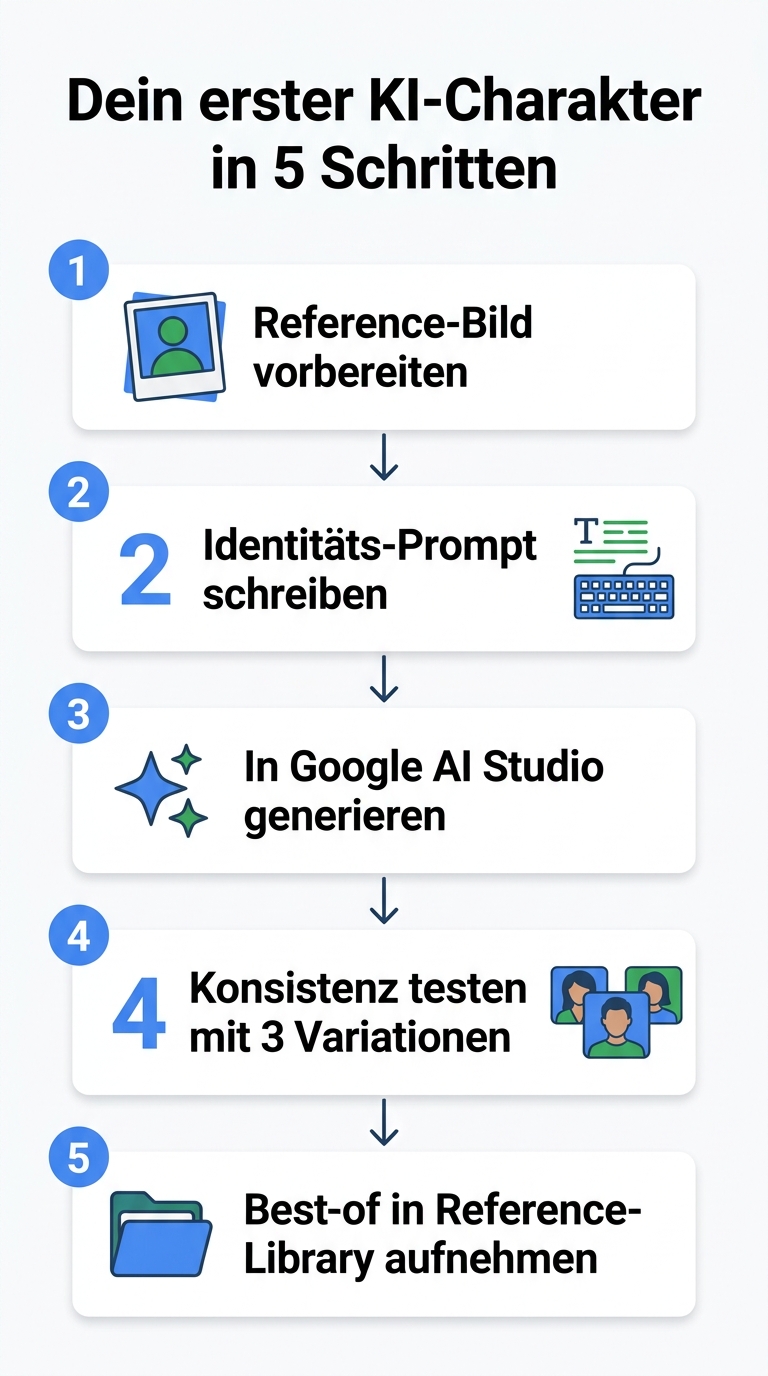

Schritt-für-Schritt: Deinen ersten KI-Charakter erstellen

Wir bauen jetzt eine fiktive Influencerin namens „Lina“ — Anfang 20, mediterrane Züge, dunkelblonde Haare, Lifestyle-Nische. Du kannst die Schritte 1:1 für deine eigene Figur übernehmen.

Schritt 1 — Reference-Image vorbereiten

Das Reference-Image ist die DNA deines Charakters. Es muss drei Dinge erfüllen:

- Frontaler Blick, leichter Smile, neutraler Ausdruck

- Diffuses, neutrales Tageslicht (kein hartes Shadow-Play, kein Studio-Strobe)

- Mindestens 1024 × 1024 px, scharf, kein Bokeh im Gesicht

Wenn du noch keines hast, generierst du ein erstes „Seed-Bild“ direkt in AI Studio mit einem reinen Beschreibungs-Prompt (siehe Schritt 2) und nutzt dieses als Reference. Diesen Bootstrap-Trick kannst du immer dann anwenden, wenn du noch kein fotografisches Material hast.

Schritt 2 — Den Identitäts-Prompt schreiben

Der Identitäts-Prompt ist die Textbeschreibung, die du zusammen mit dem Reference-Image an NB2 schickst. Er sollte präzise, aber nicht überladen sein. Template:

Portrait of [name], a [age]-year-old [ethnicity] woman with [hair color & length],

[eye color] eyes, [face shape], [distinguishing feature].

She has a [skin tone] complexion and a [body type] build.

Photorealistic, shot on Sony A7 IV, 50mm f/1.8, natural daylight, sharp focus on face.

Konkretes Beispiel für Lina:

Portrait of Lina, a 24-year-old Mediterranean woman with dark blonde shoulder-length

wavy hair, hazel eyes, oval face, a small beauty mark above her upper lip.

She has a light olive complexion and a slim athletic build.

Photorealistic, shot on Sony A7 IV, 50mm f/1.8, natural daylight, sharp focus on face.

Schritt 3 — Erste Generierung in AI Studio

Lade das Reference-Image hoch, füge den Identitäts-Prompt ein, drücke Generieren. NB2 liefert in 8–15 Sekunden ein Ergebnis. Wichtig: Lass die Auflösung auf „Auto“ stehen — das Modell wählt selbst zwischen 1K und 2K, je nach Prompt-Komplexität.

Schritt 4 — Konsistenz testen mit drei Variationen

Generiere jetzt drei verschiedene Szenen mit demselben Reference-Image und demselben Identitäts-Prompt-Block, aber unterschiedlichem Szenen-Prompt:

[Identity-Prompt von oben]

Scene: Lina sitting at a Berlin café, holding a flat white, soft window light from the left.

[Identity-Prompt von oben]

Scene: Lina walking through a park in autumn, golden hour, slight motion blur.

[Identity-Prompt von oben]

Scene: Lina in a minimalist studio, white background, three-quarter portrait, even softbox light.

Vergleiche die drei Ergebnisse: Sind die Augenfarbe, die Wimpernpartie, die Lippenform und die Asymmetrien gleich? Wenn ja, ist deine Identität stabil. Wenn nein, ist dein Reference-Image zu mehrdeutig — zurück zu Schritt 1 und ein präziseres Foto wählen.

Schritt 5 — Best-of in eine Reference-Library aufnehmen

Sobald du drei bis fünf wirklich gute Bilder hast, die deine Identität sauber zeigen, sicherst du sie in einem Ordner namens lina-references/. Dieser Ordner ist von jetzt an deine Single Source of Truth. Jedes neue Bild wird mit Reference-Images aus diesem Ordner generiert — nie mehr ohne.

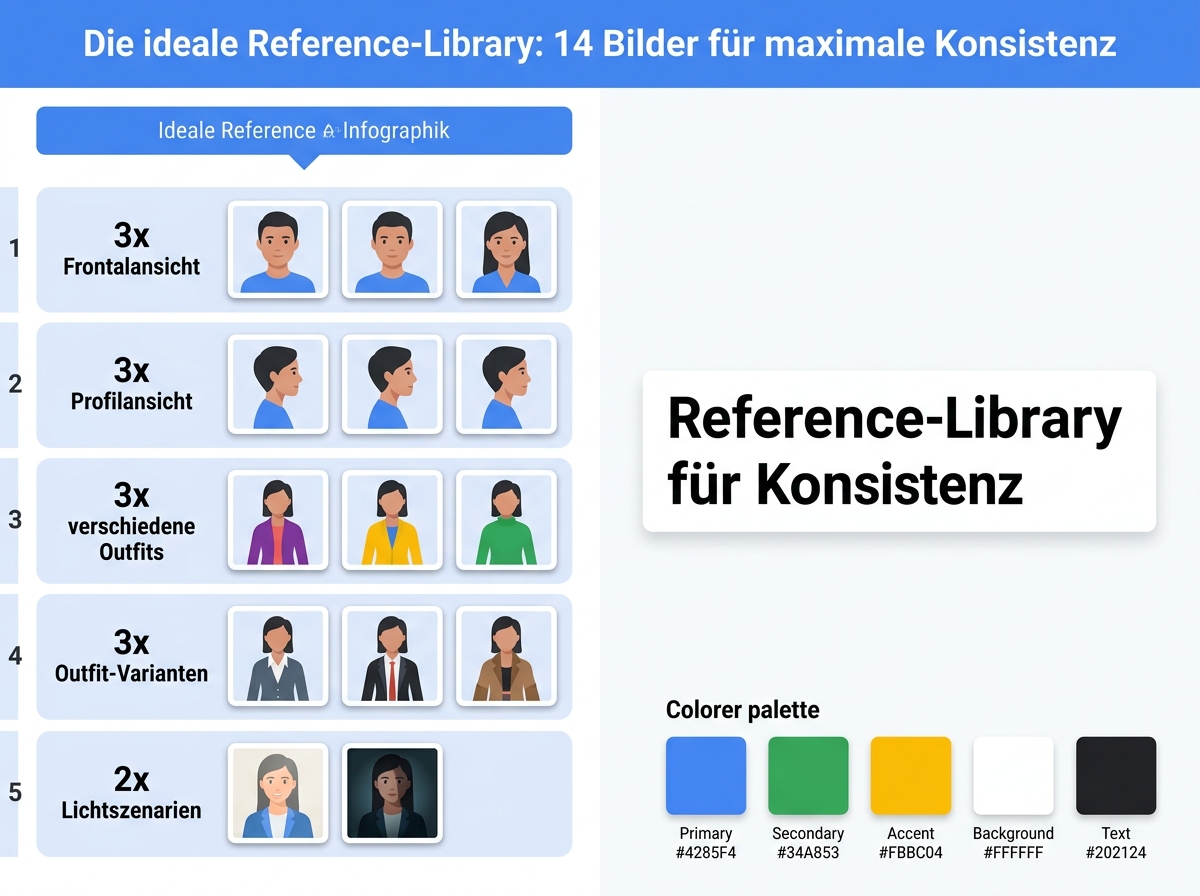

Konsistenz-Workflow mit Reference-Images

Hier kommt die Killer-Funktion. NB2 akzeptiert in einem einzelnen API-Call bis zu 14 Reference-Images. Das ist nicht einfach „mehr Bilder = besseres Ergebnis“ — die Mischung ist entscheidend.

Die ideale 14-Bild-Library: 3+3+3+3+2

Nach dutzenden Tests an unserer eigenen Pipeline hat sich diese Mischung als am stabilsten erwiesen:

- 3× Frontalansichten (verschiedene Mimik: neutral, leichtes Lachen, ernst) — verankern die Identität

- 3× Profil- und Dreiviertelansichten (links, rechts, Halbprofil) — geben dem Modell die 3D-Struktur des Gesichts

- 3× verschiedene Outfits (Casual, Sport, Going-Out) — verhindern, dass NB2 ein Outfit „klebt“

- 3× Outfit-Varianten desselben Looks (z. B. weißes T-Shirt in drei Schnitten) — lehrt das Modell Variationsraum

- 2× Lichtszenarien (helles Tageslicht + warmes Abendlicht) — stabilisiert die Hautfarbe über Kontexte hinweg

Identity Drift erkennen — und korrigieren

„Identity Drift“ ist der schleichende Effekt, dass dein Charakter über viele Generationen hinweg langsam zu einer anderen Person wird. Erkennungszeichen:

- Augenabstand verschiebt sich

- Nase wird breiter oder schmaler

- Lippenform verändert sich subtil

- Hautton wird wärmer oder kühler

Die schnelle Korrektur: Generiere eine Frontalansicht im neutralen Studio-Setup, vergleiche sie mit deinem Original-Reference. Wenn der Drift sichtbar ist, erneuere die Library — wirf die ältesten Bilder raus, ersetze durch frische Generationen, die noch dem Original entsprechen.

Wann ein neues Reference-Set fällig ist

Faustregel: alle ~200 Generationen oder bei jedem visuellen Konzeptwechsel (z. B. neue Haarfarbe, neue Frisur, neue Lebensphase). Behandle die Library wie ein Charakter-Wiki, nicht wie ein einmaliges Setup.

10 Prompt-Templates für KI Influencer

Alle Templates funktionieren mit dem 14-Bild-Reference-Setup von oben. Ersetze [CHAR] durch deinen Identitäts-Prompt-Block.

1. Lifestyle — Café

[CHAR]

Scene: sitting in a sunlit Berlin coffee shop, hands wrapped around a flat white,

window light from the left, soft bokeh of plants in background, candid moment.

35mm, f/2.0, slight grain.

2. Fashion — Studio

[CHAR]

Scene: studio editorial portrait, seamless pastel pink backdrop, full body,

oversized cream wool coat, wide-leg trousers, confident pose, butterfly lighting.

85mm, f/4.0, magazine-cover quality.

3. Travel — Strand

[CHAR]

Scene: standing on a quiet beach in Portugal during golden hour, white linen dress

moving in the wind, looking toward the horizon, warm side light.

50mm, f/2.8, cinematic.

4. Outdoor-Sport

[CHAR]

Scene: jogging on a forest trail at dawn, technical running outfit in muted earth tones,

slight sweat, focused expression, mist between trees.

35mm, f/2.5, motion blur in legs.

5. Indoor — Wohnung

[CHAR]

Scene: relaxing on a beige boucle couch in a Scandinavian apartment, oversized hoodie,

holding a book, warm afternoon light from a large window, plants and ceramics around.

50mm, f/2.0, cozy.

6. Beauty Close-up

[CHAR]

Scene: extreme close-up portrait, glowing dewy skin, minimal natural makeup,

eyes looking slightly up, neutral grey background, ring-light catchlight.

100mm macro, f/4.0, skin-detail focus.

7. Nightlife

[CHAR]

Scene: in a dim cocktail bar, holding a negroni, warm tungsten light,

shallow depth of field, blurred bartender in background, evening makeup.

50mm, f/1.8, ISO 800 grain.

8. Mirror Selfie

[CHAR]

Scene: mirror selfie in a modern bathroom, holding an iPhone 16 Pro,

casual streetwear outfit, natural pose, warm vanity lights.

Phone-camera aesthetic, slight wide-angle distortion at edges.

9. Workout

[CHAR]

Scene: gym setting, mid-set on a cable machine, athletic two-piece in dark teal,

focused gaze, warm gym spotlights, slight chalk on hands.

35mm, f/2.8, athletic editorial.

10. Food / Restaurant

[CHAR]

Scene: sitting at a Tuscan restaurant table, plate of pasta in front,

wine glass mid-air in a cheers gesture, warm candlelight, blurred Italian decor behind.

50mm, f/2.0, golden warm tones.

Speicher diese Templates in deiner Reference-Library — sie werden zu deinem Style-Fundament.

Grenzen & Workarounds

So stark NB2 ist — es gibt drei harte Wände, an die du früher oder später läufst.

NSFW-Filter sind hart. Google blockt alles unter dem Bikini-Level zuverlässig. Lingerie, Wäsche, suggestive Posen werden je nach Tagesform mal akzeptiert, mal abgelehnt — verlässlich ist nur „nicht knapper als Bademoden“. Wenn du gezielt für Plattformen wie Fanvue oder OnlyFans produzierst, brauchst du ein zweites Modell. Für die NSFW-Pipeline ist Flux mit eigenem LoRA-Training Pflicht — wir behandeln das tief im Artikel Mit KI-Influencer auf Fanvue Geld verdienen.

Kein LoRA-Training. NB2 lässt sich nicht weiter-trainieren. Du arbeitest immer mit Reference-Images zur Laufzeit, nie mit einem auf deinen Charakter feinjustierten Modell. Für 95 % aller SFW-Workflows ist das kein Problem — die 14-Reference-Image-Pipeline ist stabil genug. Wenn du absolute pixelgenaue Konsistenz brauchst (Werbung, Print, Editorial), ist Flux + LoRA die bessere Wahl.

Kosten skalieren linear. Anders als bei einem ComfyUI-Setup auf eigener GPU zahlst du jedes einzelne Bild. Bei 1.000 Bildern/Monat sind das ~€34 (Gemini API) bis ~€80 (Higgsfield). Kein Beinbruch — aber ein anderer Kostenmodus als „GPU steht eh herum“.

FAQ

Was kostet Nano Banana 2?

Im Google AI Studio ist NB2 kostenlos (Limit: ~50 Bilder/Tag). Über die Gemini API zahlst du ca. €0,03–0,04 pro Bild im Pay-as-you-go-Modell, ohne monatliche Grundgebühr. Managed-Plattformen wie Higgsfield liegen bei ~€0,08 pro Bild, dafür mit eingebauter Library-Verwaltung. Kie.AI liegt zwischen Gemini API und Higgsfield bei ca. €0,04.

Ist Nano Banana 2 besser als Midjourney?

Für Charakterkonsistenz und Reference-Image-Workflows — eindeutig ja. NB2 hält eine Identität über dutzende Bilder stabil, Midjourney driftet schon nach 5–10 Generationen sichtbar. Für rein ästhetische Fashion-Editorials ohne Konsistenz-Anspruch hat Midjourney V7 immer noch den künstlerischeren Look. Für KI Influencer ist NB2 die richtige Wahl.

Kann man mit Nano Banana 2 NSFW-Inhalte erstellen?

Nein. Google-eigene Inhaltsfilter blocken alles unter Bademoden-Niveau zuverlässig. Für NSFW-Content brauchst du ein anderes Modell — typischerweise Flux mit eigenem LoRA, lokal gehostet via ComfyUI oder über einen NSFW-erlaubenden Cloud-Anbieter.

Wie viele Reference-Images braucht man für gute Konsistenz?

Minimum sind 3 saubere Reference-Images (Frontal, Profil, Dreiviertel). Optimum sind 14 Bilder in der 3+3+3+3+2-Mischung (Frontal, Profil, Outfits, Outfit-Varianten, Lichtszenarien). Mehr als 14 ist nicht möglich — und auch nicht nötig.

Fazit

Nano Banana 2 ist 2026 das beste Modell für konsistente KI-Charaktere ohne Training-Aufwand. Mit einem sauberen Reference-Setup, einem präzisen Identitäts-Prompt und der 14-Bild-Library hältst du deine Influencer-Identität über hunderte Bilder stabil — etwas, das vor 18 Monaten noch eine ComfyUI-Doktorarbeit war.

Die nächsten zwei Schritte für dich:

- Wenn du noch unsicher bist, ob NB2 wirklich das richtige Modell für deinen Use-Case ist: Schau dir den direkten Vergleich der 7 besten KI-Bildmodelle an. Dort siehst du, wann Flux, Seedream oder Ideogram die bessere Wahl wären.

- Wenn du deinen Charakter monetarisieren willst: Lies, wie du mit einem KI-Influencer auf Fanvue Geld verdienst — inklusive der NSFW-Pipeline, die NB2 selbst nicht abdeckt.

Viel Erfolg mit deinem ersten konsistenten KI-Charakter.